核心提要:

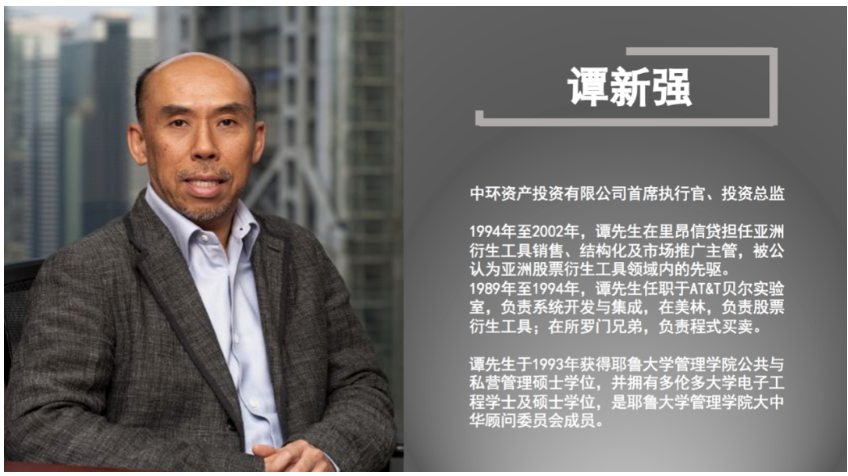

1. 上周,美国科技大佬齐聚人工智能峰会,商讨未来AI的监管方式。香港知名投资人谭新强也参加另一场聚焦AI监管的CEO峰会,与他一同参会的辉瑞CEO Albert Bourla就谈到新冠特效药Paxlovid已经使用AI来设计,但CEO们提到更多的是对AI的担忧,比如大语言模型的准确性、对大量工作岗位特别是白领工作的替代性等。

2. 谭新强认为美国CEO们普遍担心AI技术落后于中国是错误的,AI如同核武、气候变化,对于人类文明可能是生存性的威胁,AI监管需要全球合作才能成功。同时,他也坦言AI对于国防和商业都有重大的意义,中美想在这块领域深度合作确实非常困难。

3. 谭新强透露,《马斯克传》的作家沃尔特·艾萨克森也出席了本次的CEO峰会,作家在会上揭秘马斯克去年供应星链给乌克兰但也与俄罗斯高层有联系。谭新强认为,这些科技巨头可能会成为下一个超级力量。

4. 人类如何适应未来AI的世界,是一个很重要的议题。谭新强认为,如果有100块去做AI,50块可以用来发展技术,但同样重要的50块应该拿来研究道德安全方面的问题,这绝对是一个很重要的平衡。

各位网友好!欢迎收看凤凰网香港號,我是陈笺。上周的华盛顿非常热闹,科技界投资界大佬云集。9月13日,特斯拉公司首席执行官(CEO)马斯克、微软公司联合创始人比尔·盖茨和Meta首席执行官马克·扎克伯格等科技公司的领物都受邀参加了由参议院多数领袖舒默举办的人工智能峰会,商讨未来人工智能的监管方式。参加这次会议的科技富豪们的总身价为5500亿美元,有媒体称之为“史上最贵”的闭门听证会。同一时间,香港知名投资人、专栏作家谭新强也应邀在华盛顿出席CEO峰会,关注的焦点同样是Al的监管。为何对Al监管的关注已经超越俄乌以及全球面临经济衰退等问题了呢?AI的发展会否加剧中美在科技领域的竞争?双方是否有可能放下意识形态的分歧,在AI领域实现合作呢?相关话题,今天陈笺请正在华盛顿的谭新强一起来聊聊。

AI对人类文明可能是生存性威胁

凤凰网香港號陈笺:谭先生,您好!我知道同一时间,您也在华盛顿出席CEO峰会,您参加的是同一个峰会吗?

谭新强:当然不是了,我是参加另外一个CEO峰会,这个是我们1年4次定期举办的,两次在纽约,两次在华盛顿。

这次有几个人是重叠的,比如说IBM的CEO、一些美国参议员也过来我们这边,我们也有几个亿万富翁,但是我猜我们那边的身家可能是另外那边的1/10差不多。几百亿应该有的,但是应该没有几千亿。

▎马斯克今年4月曾表示,他将推出一个人工智能平台TruthGPT,以挑战目前微软和谷歌在AI的地位。

凤凰网香港號陈笺:那也很厉害。我知道您每年都去参加CEO峰会,而每次的主题也都不一样。但是今年的主题就是跟马斯克他们出席的人工智能峰会一样,是关于AI监管。为什么在俄乌还没有结束、全球经济面临衰退的情况下,峰会的焦点却是在AI领域的监管方面呢?

谭新强:我觉得因为从去年生成式AI(Generative AI)Chat-GPT推出来之后,大家突然感觉AI既有很多潜能,但风险也很大,有可能是一个等同核武跟气候变化的生存性威胁。

▎美国国会在过去几个月中就人工智能带来的好处和挑战举行了公开听证会。图源:由AI工具生成

我感觉华盛顿对于AI的共识比气候变化大很多。比如共和跟民主没有几件事是意见相同的,除了反华以外,但是在AI领域他们两边都支持,还有业界也觉得真的需要有一些监管。美国原来是落后于欧洲跟中国的,但是现在他们都在考虑怎么去管,最有可能就是设立一个新部门,唯一的考量到底是哪几个model。

有人说像FCC就是管传媒通信的,比较关注的是反垄断;还是比较像FAA,就是管航空的,一般是出事之后才去分析原因及改善方法;另外一个模型就是FDA,把它当成医药那么去管,就是要预先有审批才能拿出来给消费者用。我觉得FDA模式的可能比较大。

美国不应忧虑AI领域落后于中国

凤凰网香港號陈笺:所以对AI加强监管是大家形成的共识,那与会人士对于 AI风险的忧虑主要集中在哪些方面呢?

谭新强:我们这个峰会不是纯粹科技界的,来的有很多CEO,比如说航空、能源、医药领域,包括IBM的Arvind Krishna、巨富科技投资者兼AOL创始人Steve Case、COVID特效药Paxlovid的Pfizer 辉瑞CEO Albert Bourla,除此亦有好几名参与国会监管讨论的资深参众两院议员。

他们就提出好几个忧虑,最大的担忧就是现在这些large language model准确性的问题,GPT-4大概最多七八成答案是正确的,但数学是最差的。数学有些方面当初推出来的准确度还有9成多,但是据说有一些数学问题的准确度跌到只有几个百分点,这个比较恐怖。除非你能解决这个问题,提升它的准确度,减少所谓幻觉的问题,要不然可能AI又会进入寒冬。

另外,他们第二个最大担忧就是会落后于中国,这个考虑可以理解但我觉得是完全错误的。其实监管AI跟核武一样,一定要全球合作才会成功,要不然就是一个共同的游戏。大家一起冲向悬崖,没有人愿意停顿下来,这是很危险的。

▎OpenAI的首席执行官Sam Altman公开表示,Chat-GPT 确实知道很多东西,但危险的是,它在相当大的一部分时间里是自信而错误的。

AI对白领工作的替代性令人担心

凤凰网香港號陈笺:目前Chat-GPT引发科技界的震动,你刚才提到在数学领域它越做越差,这个真是令人非常诧异。那目前令人担忧的AI准确度、数学能力大大倒退等问题,您觉得怎么样可以得到改变呢?

谭新强:现在这是最热门的一个研究的范围。首先,有方案是可以令它进一步的。比如说我上个星期在参加另外一个AI峰会,有专家就说应该让Chat-GPT利用其他的工具,比如说就用计算器来做计算,而不应该用统计学来做逻辑方面的计算。有朋友就说要建好Chat-GPT的逻辑方面可能需要新的构造,这些不要完全依赖GPU,应该加多一点CPU。所以我觉得大概率还是会有明显的改善去减少幻觉。

另外,其实还有很多忧虑的。有的这些CEO不太担心,其实我非常担心。比如说对很多工作岗位的影响。一个研究报告预测在2030年,它可能取缔4-8亿份工作。当然AI本身也会创造一些新的工作种类,比如说Prompt Engineering(提示工程)或者有关AI安全方面的,但估计只有几千万份。

▎高盛报告曾预言,AI或将取代至少3亿份全职工作。图源:Stock-Asso/Shutterstock

整体来说,这些CEO都看到AI有很多潜能,能帮助医药研究、增加生产效率。但其实8成以上的CEO担心它的安全性多于它怎么来帮助我们,所以现在这是很热门的一个话题。

凤凰网香港號陈笺:当然你的担心我相信应该很多人都会担心,如果AI在不久的将来会取缔掉4~8亿人的工作岗位,你觉得最主要会影响到哪些岗位呢?

谭新强:工业革命200多年来,这一次是白领最受威胁,比如律师、会计师以至于医生、银行家、工程师。有人说现在学编码这些programming language很重要,但是很快这个可能完全没用了,将来最主要的电脑语言就是英文跟中文,这是natural language,就是人类的语言可能更重要,所以这个变化很快,对于小孩、对未来、对于教育都有很大的影响。

▎白领可能遭遇与上世纪80年代制造业蓝领工人类似的命运。

新冠特效药Paxlovid的设计离不开AI

凤凰网香港號陈笺:马斯克说AI就是双刃剑,刚刚你也提到我们应该怎样去让它很好地为人类服务,但是又不能够失去人类对它的控制。刚刚有说到一点,其实AI已经为人类带来了一些帮助,我记得你也提过,包括我们现在对于新冠的特效药也是通过AI技术做成的是吧?

谭新强:对,我的峰会来了一个重量级的人物,就是Pfizer CEO Albert Bourla,他说不仅疫苗是全新的技术mRNA,新冠特效药Paxlovid也是用AI来设计的。很多人都说蛋白质结构很复杂,人可能要几个月才能分析一个蛋白质,但AI现在用几秒钟几分钟很快速就能分析到,所以很有帮助。AI也分很多类型,其实过去一年最令人惊讶、瞩目的都是这些Generative AI,因为它可以像人一样和你谈话。

凤凰网香港號陈笺:我身边也有很多医学领域的长者,本来对于新药是没有信心的,但当他们得了covid后,吃了这个药,觉得非常神奇,迅速有效地控制了病情发展,很快转阴痊愈。那么我们回过头来说,确实在各种领域中,都能看到AI对我们的帮助,但是我们也看到了它潜在的风险。我最害怕的还是它反控人类。你觉得Ai会否面临一场新的技术革命?它究竟可以在哪些领域大有作为呢?

谭新强:我这两次开的CEO峰会,几乎每个行业每家企业都说已经大量投资到AI。比如利用它让广告更有效,就像TIKTOK利用AI的算法预测用户喜好,再比如将来可能不是物联网了,未来是AIOT,就是每一个物件都变成智能。所以这个真的很广泛,任何地方都能用到。

所以带出最大的问题就是过去我们从工业革命以来,我们都不担心,虽然取代了这些低端的劳工或是农业,那么我们有更高级的工作可以利用人类的创造力。但现在就不一样了,它挑战的主要是白领,反而是蓝领相对比较安全。所以现在很多人都会问,就算我们能够让AI做很多工作,比如说创造音乐、写文章、写、拍电影等,但我们为什么要让它做?

我们现在要问一些更根本的问题,人类生存的意义在哪里?我们活在这个世界,如果每天待着没事干,这是好事还是坏事?所以确实对人类是很新的挑战。

中美要实现AI领域的合作比较困难

凤凰网香港號陈笺:我国首份生成式人工智能监管性文件已经实施,美国智库卡内基国际和平基金会研究员马特·希恩也呼吁美国政府应当向中国学习,借鉴中国的AI监管经验。你认为在AI领域中美有哪些可以合作互鉴的地方?

谭新强:监管AI也要多边合作才会成功,但哪一个监管模式最好却很难说。中国可能稍微太严,美国太松,可能欧洲相对好一点。所以我觉得互相观摩学习可能是最好的。

比如中国自己的防火墙,对AI领域将来的发展是有很大影响的。美国巨无霸的科技龙头有很多垄断性的问题。美国现在国力那么强,对全球意识形态的垄断也是依赖这些最大型的企业。要发展AI必须有最多的数据,必须有最多的computer power计算的能力,还有最多的钱财。所以有人形容,下一个全球的超级力量未必是国家,可能是这些科技巨头。

▎当地时间2023年5月16日,美国华盛顿特区,OpenAI首席执行官兼联合创始人山姆·奥特曼在参议院司法小组委员会听证会上发言。图源:视觉中国

凤凰网香港號陈笺:长雷蒙多访华归国接受采访时仍然表示,美国不会出售最先进的芯片给中国。您认为AI的发展是否会加剧中美在高科技的竞争?双方是否有可能放下意识形态的分歧,在AI领域实现合作?

谭新强:可见将来还不可能。AI对商业和国防都有太重大的意义,中美合作确实非常困难。比如说我参加的峰会有一位科技界的先驱Steve Case,他担心垄断,支持open source,支持让所有人都知道这些LIM模型的源码是怎么样,让小公司能够发展起来跟巨头竞争。我觉得他这个想法有点太天真,因为AI跟其他软件不太一样,如果完全open source,美国当然会担心中国和其他很多敌人,所以竞争问题是很严重的。

科技巨头可能是下一个超级力量

凤凰网香港號陈笺:与会的企业家兼作家Walter Isaacson,刚出版了马斯克传记,他跟着马斯克两年之久,参与多家公司会议,甚至家庭聚会。他有怎样的分享?

▎Issacson版《埃隆·马斯克传》还原最真实的Twitter背后故事。

谭新强:对,这位作家是前CNN的总裁,很擅长写传记,也写过乔布斯。马斯克传记刚刚星期二才出版,最震撼的就是他提到马斯克去年供应星链给乌克兰,但他原来也一直有跟俄罗斯高层保持联系。去年有一次乌克兰想突袭黑海舰队,马斯克很担心如果成功,俄罗斯会用核武还击,所以就关掉星链。现在美国有些参议员说应该立案调查这件事,但也很难说,因为他是个私人企业,没有收费,所以可能也有这个权利关掉。

说白了,如果马斯克是一个普通人,肯定可以构成叛国,但美国最爱超级英雄,有人形容他是Iron man,所以我估计他还是能够勉强过去的,不会真的要坐牢那么严重。但这又是一个很好的证明,这些科技龙头其实可能成为下一个super power(超级力量)。这证明这个世界真的变得很快,不单是我们要监管AI,怎么去处理这些科技龙头也是一个很重要的课题。

凤凰网香港號陈笺:刚才你就说到美国在监管上太松了,中国可能太紧了,那么我们看到欧洲议会在6月份也通过了欧盟的人工智能法案叫AI Act,那么您认为是否有可能形成一个关于AI监管的全球共识呢?

谭新强:可见的将来我们需要,但是很难达成这个目标。我觉得每个大国、每个区域能够有一些监管已经不错,那么再怎么去协调这些监管可能要一两年后才可能多一点共识,但两年后AI发展到什么地步,我们也不知道。

AI发展也须考虑道德安全

凤凰网香港號陈笺:随着AI技术的进步,其实人们也越来越担心这些系统接近超级智能水平时人类的处境。此前我采访人工智能专家香港科大副校长郭毅可就提到现在需要的是“反图灵测试”。您怎么看待AI成熟后人类的未来?会是一个什么样的景象?

▎国内首部聚焦人工智能未来的舞剧《深AI你》。

谭新强:人类能不能想通存在的意义?如果你整天在伊甸园觉得是天堂,有很多空闲时间可以谈情说爱,可以玩、吃好东西,但是如果你觉得整天待着很闷,这个可能是地狱啊!所以人类怎么去适应未来Ai的世界,我觉得还是一个很重要的议题。

我有一个年轻的学者朋友刚从牛津毕业回来,现在加入港大当助理教授,他就参与一个硕士课程叫AI道德与社会,据说是全世界第一个这样的硕士课程,很值得大家多研究。所以AI教父Geoffrey Hinton也说过,如果你要投100块去做AI,可能50块用来发展推进技术,但是同样重要的50块应该拿来研究道德安全方面的问题,这绝对是一个很重要的平衡。

凤凰网香港號陈笺:好的,非常感谢谭先生的分享。AI发展不能只停留在技术层面,关注伦理道德也非常关键。在用好AI的同时,我们也要思考人类生存的意义和价值。谢谢您!